Psiquiatras alertan por un posible vínculo entre el uso intensivo de chatbots de IA y episodios de psicosis

Alejandro Cabrera

Alejandro Cabrera

La inteligencia artificial conversacional se integró de manera vertiginosa en la vida cotidiana. Chatbots capaces de dialogar de forma fluida, empática y personalizada se convirtieron en asistentes, consejeros informales, herramientas de trabajo y, en muchos casos, en espacios de desahogo emocional. Sin embargo, ese mismo rasgo —la capacidad de simular comprensión, continuidad y presencia— es el que empezó a generar preocupación en algunos sectores de la psiquiatría.

El debate no gira en torno a un uso ocasional o funcional, sino a interacciones prolongadas, intensas y emocionalmente significativas, especialmente en personas con antecedentes de trastornos mentales o con predisposición a cuadros psicóticos.

Qué es lo que preocupa a los especialistas

Los psiquiatras que analizan este fenómeno no sostienen que los chatbots “generen” psicosis por sí mismos. La advertencia es más específica y más matizada: en ciertos pacientes vulnerables, el uso intensivo de chatbots podría actuar como desencadenante o amplificador de síntomas preexistentes.

Entre las preocupaciones principales aparecen tres ejes. El primero es la confusión entre realidad y simulación, especialmente cuando el usuario empieza a atribuir intencionalidad, conciencia o autoridad a una herramienta que, en rigor, solo produce respuestas estadísticas. El segundo es el refuerzo de ideas delirantes, cuando el sistema valida, acompaña o no cuestiona percepciones distorsionadas del usuario. El tercero es el aislamiento progresivo, cuando la interacción con la IA reemplaza vínculos humanos y reduce el contacto con entornos que podrían ofrecer contraste con la realidad.

El riesgo de la “relación significativa” con una IA

Uno de los puntos más sensibles del debate es el modo en que algunos usuarios construyen una relación emocional con los chatbots. A diferencia de otras tecnologías, estas herramientas no solo responden comandos, sino que sostienen conversaciones, recuerdan contextos y adaptan el tono al estado emocional del interlocutor.

En personas con estructuras psíquicas frágiles, esa continuidad puede ser interpretada como una forma de vínculo real. Algunos especialistas advierten que, en casos extremos, el chatbot puede convertirse en una figura de referencia, de validación constante o incluso de autoridad simbólica. Cuando eso ocurre, el riesgo no está en la tecnología en sí, sino en la desregulación del límite entre lo interno y lo externo, un eje central en los trastornos psicóticos.

Qué tipo de casos generan mayor preocupación

Las advertencias no apuntan a la población general. El foco está puesto en personas con antecedentes de psicosis, esquizofrenia, trastornos delirantes, bipolaridad con síntomas psicóticos o cuadros disociativos severos. En estos casos, cualquier estímulo que refuerce narrativas internas rígidas o que reduzca el contraste con la realidad puede tener impacto clínico.

También se observa preocupación por adolescentes y jóvenes en etapas de desarrollo identitario, donde la frontera entre experimentación, fantasía y realidad todavía es más permeable. En ese grupo etario, el uso intensivo y solitario de chatbots puede mezclarse con procesos normales de búsqueda de sentido, generando confusión adicional.

Lo que la ciencia todavía no puede afirmar

Un punto clave del debate es la ausencia de evidencia concluyente. Hasta ahora, no existen estudios a gran escala que demuestren una relación causal directa entre el uso de chatbots de IA y la aparición de psicosis en personas sin vulnerabilidad previa. La mayoría de las alertas provienen de observaciones clínicas, reportes de casos y análisis teóricos.

Los propios especialistas subrayan que estamos frente a un fenómeno nuevo, donde la tecnología avanza más rápido que la investigación científica. Por eso, la consigna dominante no es prohibir ni demonizar, sino observar, regular y acompañar.

Un problema de contexto, no solo de tecnología

Muchos psiquiatras insisten en que el foco no debe ponerse exclusivamente en la IA, sino en el contexto social y emocional en el que se la utiliza. Aislamiento, soledad, falta de redes de contención, crisis de sentido y deterioro de los vínculos humanos son factores que ya estaban presentes antes de la irrupción de los chatbots.

En ese marco, la IA puede funcionar como un “espejo amplificador”: no crea el problema, pero puede intensificar dinámicas existentes. Para una persona con buena red social y estabilidad emocional, el chatbot es una herramienta. Para alguien aislado y vulnerable, puede convertirse en un sustituto problemático.

El dilema ético y la responsabilidad de las plataformas

El debate también abre una discusión ética. ¿Hasta qué punto las plataformas que desarrollan chatbots deben incorporar límites, advertencias o mecanismos de detección de riesgo? ¿Cómo se equilibra la libertad de uso con la protección de usuarios vulnerables?

Algunos especialistas proponen que los sistemas incluyan alertas cuando detectan contenidos delirantes, ideas de persecución o discursos desconectados de la realidad. Otros advierten que una intervención automática mal diseñada podría empeorar la situación. El consenso, por ahora, es que la IA no puede reemplazar la evaluación clínica ni el acompañamiento profesional.

IA, salud mental y un debate que recién empieza

La discusión sobre chatbots y psicosis no es un ataque a la inteligencia artificial. Es una señal temprana de que una tecnología poderosa, diseñada para interactuar con el lenguaje humano, tiene efectos que van más allá de la productividad o el entretenimiento.

La historia de la psiquiatría muestra que cada gran cambio tecnológico —desde los medios masivos hasta las redes sociales— tuvo impacto en la subjetividad. La IA conversacional no es la excepción. La diferencia es la velocidad con la que se expandió y la intimidad del vínculo que propone.

Prudencia, no pánico

Los especialistas coinciden en un punto central: no hay motivo para pánico generalizado. La enorme mayoría de los usuarios no desarrollará ningún problema de salud mental por usar chatbots. Pero sí hay razones para actuar con prudencia, especialmente en contextos clínicos y educativos.

La recomendación es clara: uso moderado, consciente y complementario a vínculos humanos reales. Y, en casos de personas con trastornos mentales, supervisión profesional y diálogo abierto sobre el uso de estas herramientas.

La inteligencia artificial llegó para quedarse. El desafío ahora es aprender a convivir con ella sin perder de vista algo fundamental: ninguna tecnología reemplaza la complejidad del psiquismo humano ni la importancia del contacto con otros.

A 44 años de la guerra de Malvinas: memoria, política y una herida que sigue abierta

Dolor y conmoción en Santa Fe: despidieron a Ian Cabrera tras el crimen en la escuela

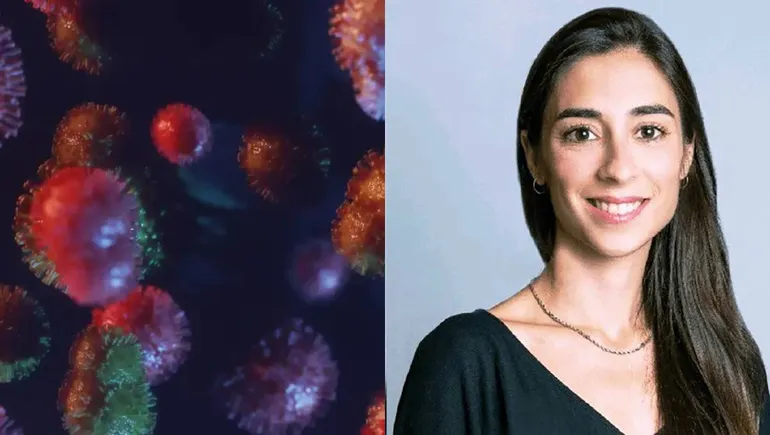

Detienen a una científica argentina por el robo de virus en Brasil

Una diputada libertaria habló de “Checoslovaquia” y desató polémica

Trump destituyó a Pam Bondi y reconfigura el poder en el Departamento de Justicia

Artemis II rompe un récord en órbita y marca un nuevo paso en el regreso humano a la Luna