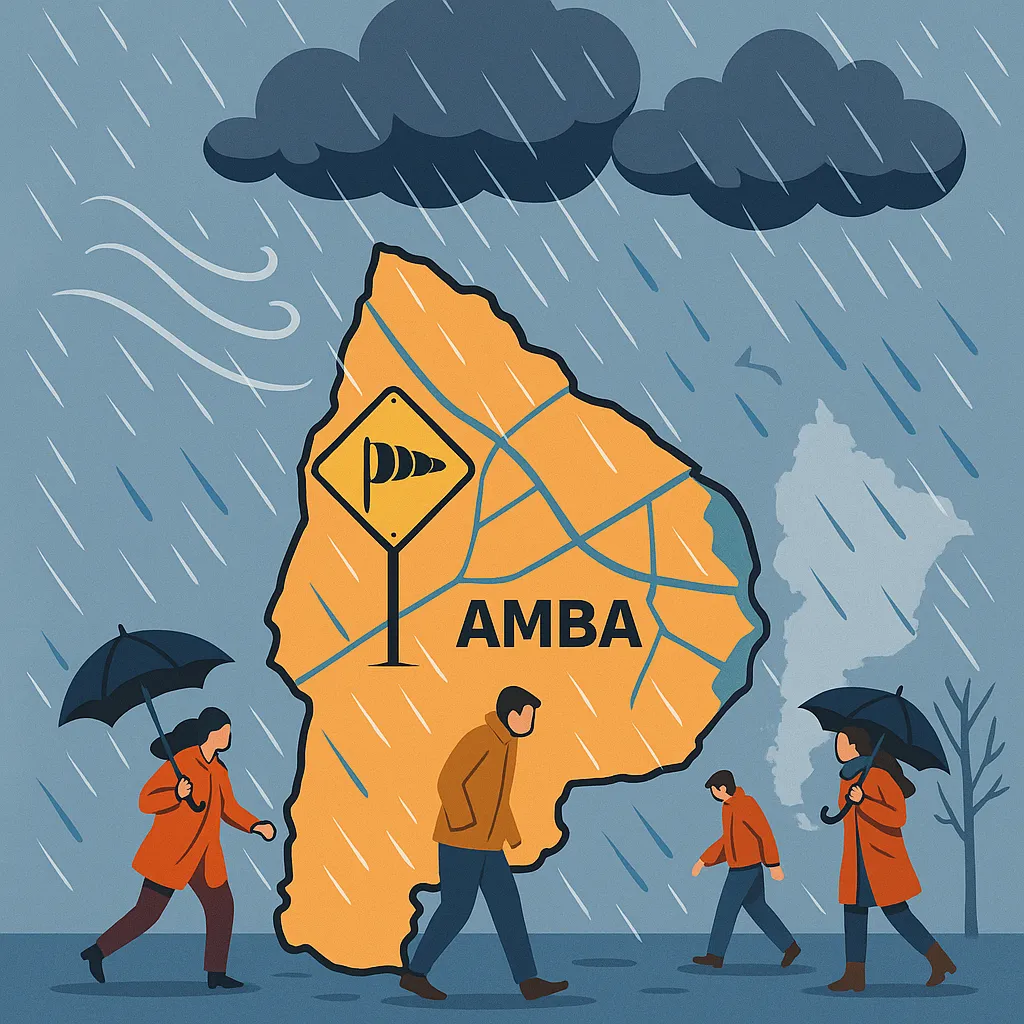

Alerta por ciclogénesis: lluvias y fuertes vientos impactarán en el AMBA y gran parte del país

La semana comenzó con inestabilidad y se espera que el martes sea la jornada más crítica. Habrá lluvias intensas, tormentas localizadas y ráfagas de viento que afectarán a la Capital Federal, el conurbano y varias provincias del centro y norte argentino.